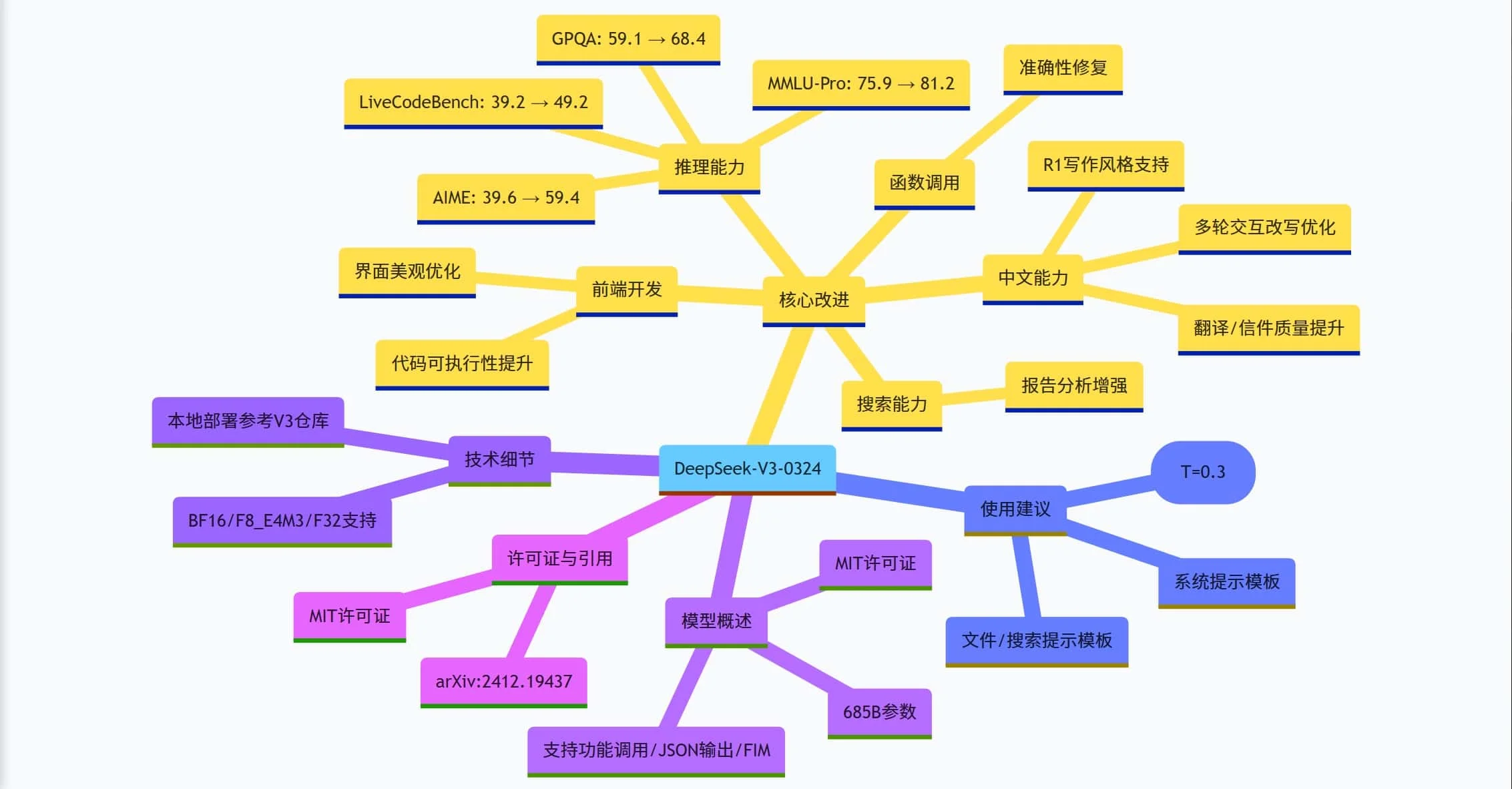

DeepSeek-V3-0324 是深度求索公司发布的大规模语言模型,相比前代在推理能力(如 MMLU-Pro 从 75.9 提升至 81.2,AIME 从 39.6 跃升至 59.4)、前端开发代码可执行性、中文写作质量(支持 R1 风格)、搜索能力(增强报告分析)及函数调用准确性等方面均有显著优化。模型参数达685B,采用MIT 许可证,并提供了温度参数映射机制(API 温度 1.0 对应模型温度 0.3)和文件上传 / 网页搜索的提示模板。

详细总结

模型核心信息

| 维度 | 描述 |

|---|---|

| 名称 | DeepSeek-V3-0324 |

| 发布方 | 深度求索(DeepSeek-AI) |

| 参数规模 | 685B |

| 许可证 | MIT |

| 支持特性 | 函数调用、JSON 输出、FIM 补全、多语言支持 |

关键改进与性能

- 推理能力提升

| 基准测试 | 前代(DeepSeek-V3) | 当前(V3-0324) | 提升幅度 |

|---|---|---|---|

| MMLU-Pro | 75.9 | 81.2 | +5.3 |

| GPQA | 59.1 | 68.4 | +9.3 |

| AIME | 39.6 | 59.4 | +19.8 |

| LiveCodeBench | 39.2 | 49.2 | +10.0 |

- 功能增强

- 前端开发:优化代码可执行性,提升网页 / 游戏界面美观度。

- 中文能力:支持 R1 写作风格,增强中长篇内容质量,优化多轮改写和翻译能力。

- 搜索能力:增强报告分析的细节输出。

- 函数调用:修复前代版本的准确性问题。

使用建议

- 系统提示:需包含日期,格式为

该助手为DeepSeek Chat,由深度求索公司创造。今天是{current date}。 - 温度参数:API 温度 1.0 对应模型温度 0.3,建议通过映射机制调用。

- 文件 / 搜索提示模板:

- 文件上传模板需包含文件名、内容和问题。

- 搜索结果需结合日期、筛选相关性,并按格式引用上下文。

技术细节

- 模型结构:与 DeepSeek-V3 一致,支持 BF16、F8_E4M3、F32 精度。

- 本地部署:需参考 DeepSeek-V3 仓库,暂不支持 Hugging Face Transformers。

4. 关键问题与答案

Q1:DeepSeek-V3-0324 相比前代在哪些领域有显著改进?

A1:在推理能力(MMLU-Pro 提升 5.3,AIME 提升 19.8)、前端开发代码可执行性、中文写作质量(支持 R1 风格)、搜索能力(增强报告分析)及函数调用准确性方面均有显著优化。

Q2:模型的技术参数和许可证是什么?

A2:参数规模为685B,采用MIT 许可证,支持 BF16、F8_E4M3、F32 精度,需通过 DeepSeek-V3 仓库进行本地部署。

Q3:如何通过 API 调用该模型?需要注意哪些参数设置?

A3:API 调用时,温度参数 1.0 会映射为模型内部温度 0.3,需通过系统提示指定日期,并遵循文件上传和搜索提示的模板格式。

优先体验 <strong>DeepSeek-V3-0324</strong> 点击下方链接

📢 免责声明 | 工具使用提醒

1️⃣ 本文内容基于发布时已知信息整理,AI技术及工具更新频繁,请以官方最新说明为准。

2️⃣ 推荐工具经过基础筛选,但未进行深度安全验证,请自行评估适用性及风险。

3️⃣ 使用第三方AI工具时,请注意数据隐私保护,避免上传敏感信息。

4️⃣ 本网站不承担因工具误用、技术故障或内容偏差导致的直接/间接损失。

5️⃣ 部分工具可能涉及付费订阅,请理性决策,本站不含任何投资建议。